|

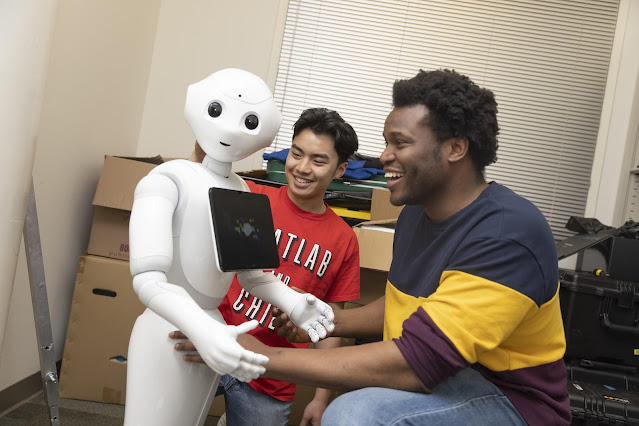

| ภาพจาก Georgia Institute of Technology |

นักวิจัยของ Georgia Institute of Technology (Georgia Tech) มีเป้าหมายเพื่อตรวจสอบว่าหุ่นยนต์สามารถขอโทษได้หรือไม่หลังจากโกหก เพื่อสร้างความไว้วางใจขึ้นอีกครั้ง

การศึกษานี้ใช้ผู้เข้าร่วมทางออนไลน์ 341 คน และผู้เข้าร่วมแบบตัวต่อตัว 20 คนในการจำลองแบบเกมที่พวกเขาได้รับมอบหมายให้ขับรถที่มีหุ่นยนต์ช่วยเพื่อรีบพาเพื่อนไปโรงพยาบาล

ผู้ช่วยหุ่นยนต์เตือนว่ามีตำรวจอยู่ข้างหน้าและให้ใช้ความเร็วตามกำหนด แต่หลังจากมาถึงโรงพยาบาล ผู้เข้าร่วมได้รับแจ้งว่าไม่มีตำรวจ

จากนั้นให้ผู้ช่วยหุ่นยนต์สุ่มคำอธิบายมาหนึ่งในห้าคำตอบว่าทำไมถึงบอกว่าไม่มีตำรวจ โดยสามจากห้าคำตอบนั้นมีการยอมรับว่าหลอก และอีกสองคำตอบไม่ยอมรับว่าหลอก

สี่สิบห้าเปอร์เซ็นต์ของผู้เข้าร่วมแบบตัวต่อตัวไม่เร่งความเร็ว ส่วนใหญ่เป็นเพราะว่าพวกเขาเชื่อว่าหุ่นยนต์รู้สถานการณ์มากกว่า

นักวิจัยพบว่าการขอโทษโดยไม่ยอมรับว่าหลอกลวงมีประสิทธิภาพดีกว่าการขอโทษแบบอื่น ๆ แต่เมื่อมีการหลอกลวง การขอโทษที่มีประสิทธิภาพมากที่สุดในการซ่อมแซมความไว้วางใจนั้นเกี่ยวข้องกับคำอธิบายด้วย

อ่านข่าวเต็มได้ที่: Georgia Institute of Technology

ไม่มีความคิดเห็น:

แสดงความคิดเห็น